Effets spéciaux numériques : comprendre les dessous du cinéma

Beaucoup se sont déjà interrogés sur la manière dont George Lucas avait créé une galaxie entière pour son mythique Star Wars. Une chose est sûre : les effets spéciaux ont largement contribué au succès de la trilogie, pionnière dans le domaine !

Contrairement à ce que nous pourrions penser, les effets spéciaux sont présents dans tous les films, du film fantastique à la comédie romantique. Pourtant, nous l’ignorons la plupart du temps. Comment les fabrique-t-on ? Comment les identifier ? Zoom sur les différentes techniques utilisées pour repousser les limites du possible.

Les effets spéciaux, qu’est-ce que c’est ? Point sur les définitions.

Avant toute chose, commençons par quelques définitions. Le terme « effet spécial » regroupe l’ensemble des techniques utilisées dans l’audiovisuel pour créer l’illusion d’action et simuler des objets, des personnages, des environnements ou des phénomènes (météorologiques, sonores, etc.) qui n’existent pas dans la réalité ou qui ne peuvent être filmés lors du tournage. Leur but est de paraître le plus réel possible, on parle alors également de « trucages » : fondus dans le réel, le spectateur ne les remarque pas.

Nous pouvons néanmoins distinguer deux types d’effets spéciaux :

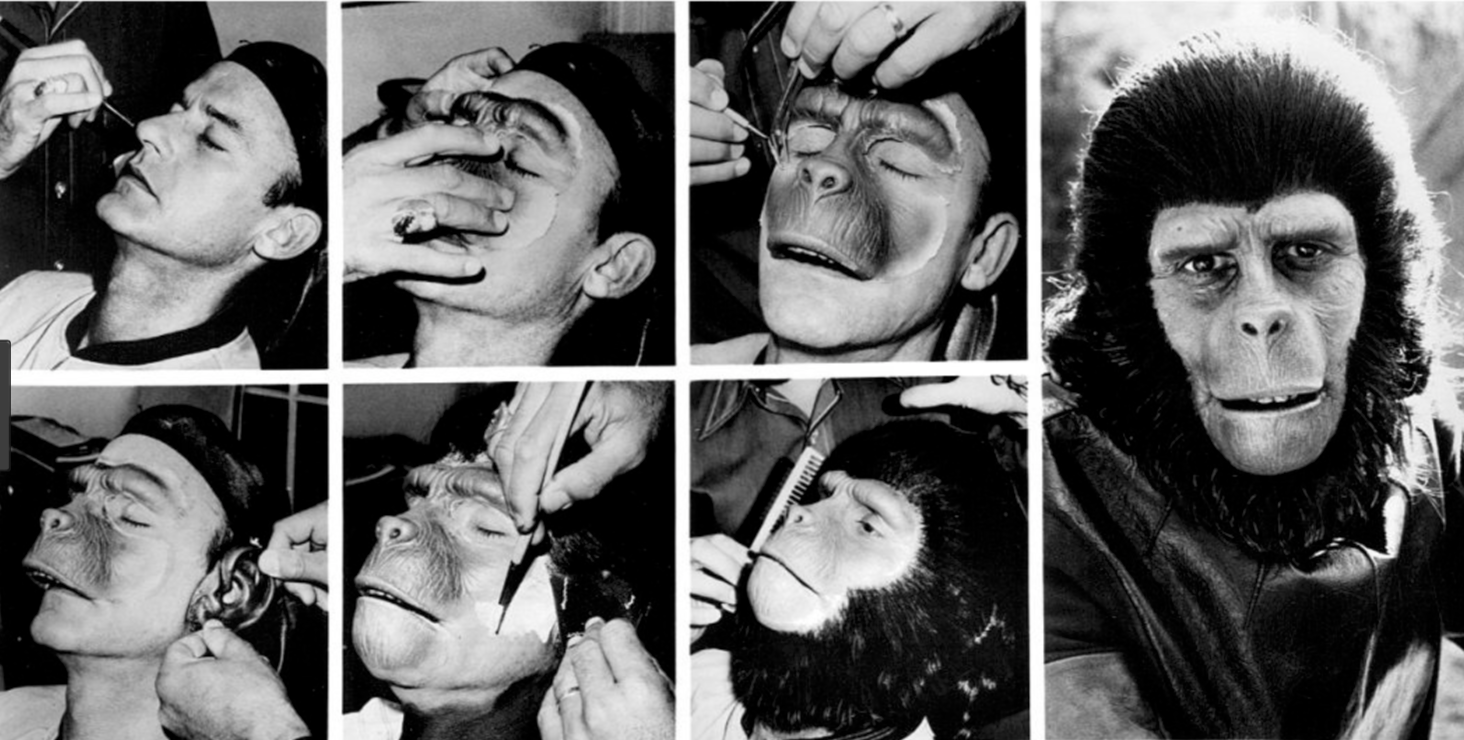

- Les effets spéciaux mécaniques (ou SFX pour Special Effects) sont des effets tangibles créés manuellement pour les besoins du film et implantés directement sur le plateau, tels que le maquillage (oui, la cicatrice d’Harry Potter est bien un effet spécial), les maquettes, la pluie artificielle, etc.

- Les effets visuels ou numérique (ou VFX pour Visual Effects) sont des techniques par lesquelles l’image est créée ou modifiée numériquement car le faire mécaniquement serait trop compliqué voire impossible (cf. le nez reptilien de Voldemort).

Mais concrètement, comment c’est fait ? Point sur les techniques.

Comme nous l’avons vu, tous les effets spéciaux ne sont pas liés au numérique. Il fut même un temps où tout était fait mécaniquement ou par des effets de caméra. 2001, l’Odyssée de l’espace, le célèbre Kubrick, est un très bon exemple de film de science-fiction filmé sans recours au numérique. Pour ceux qui souhaiteraient en savoir plus, voici un article très intéressant sur la manière dont les effets spéciaux ont été créés pour les besoins du film.

Néanmoins, il est indéniable que le développement de l’informatique a permis l’émergence de nouvelles techniques, révolutionnaires pour l’industrie du film. Penchons-nous donc davantage sur la création des effets numériques.

La motion capture : l’art de créer des êtres vivants

La motion capture permet de créer des êtres vivants en enregistrant les mouvements d’un sujet (une personne la plupart du temps, mais parfois un animal ou un objet) et en les reproduisant dans un environnement virtuel. C’est ainsi que la célèbre créature du Seigneur des Anneaux, Gollum, a pris vie au cinéma. La source de données utilisée dans ce cas est l’acteur Andy Serkis. De nombreux capteurs placés sur son corps permettent de capturer ses mouvements et ses expressions faciales, puis de les retranscrire virtuellement. Ainsi, les mouvements de Gollum paraissent réels.

Voici une vidéo explicative de Nature Video qui plaira aux fans de Tolkien.

Il existe différents types de motion capture. La plus utilisée au cinéma est la capture optique. Les capteurs placés sur le corps de l’acteur réfléchissent des rayons infrarouges envoyés par la caméra (spéciale motion capture). Ces réflexions aident ainsi à capturer le mouvement et à le retranscrire. Une fois le mouvement enregistré, il est traité numériquement afin de transposer le physique de la créature sur celui de l’acteur.

Le matte painting : la création de décors

Le matte painting est une technique qui permet de créer un décor ou de modifier un paysage selon les besoins du film, puis de l’intégrer à une scène filmée. Cette technique n’a pas toujours été liée au digital, puisqu’il s’agissait à l’origine de peindre un décor sur des grandes plaques de verre afin de les intégrer au plateau.

Aujourd’hui, tous les genres de films utilisent le matte painting. Grâce à l’avènement du numérique, les décors créés paraissent de plus en plus réels. Il est de plus en plus difficile pour le spectateur de remarquer l’effet spécial. Ainsi, il permet aux réalisateurs de créer des univers imaginaires ou de reconstituer un environnement. À partir d’un tournage sur fond vert ou bleu, le matte painting est incorporé numériquement à la scène lors de la période de post-production. C’est ainsi que le Dallas des années 1960 a pu être reconstitué afin de reproduire la scène de l’assassinat de JFK dans le film Jackie.

Pour ceux qui souhaiteraient se lancer dans l’art du matte painting, voici un article qui donne quelques astuces pour créer son propre décor numérique.

L’incrustation : tout savoir sur le célèbre fond vert

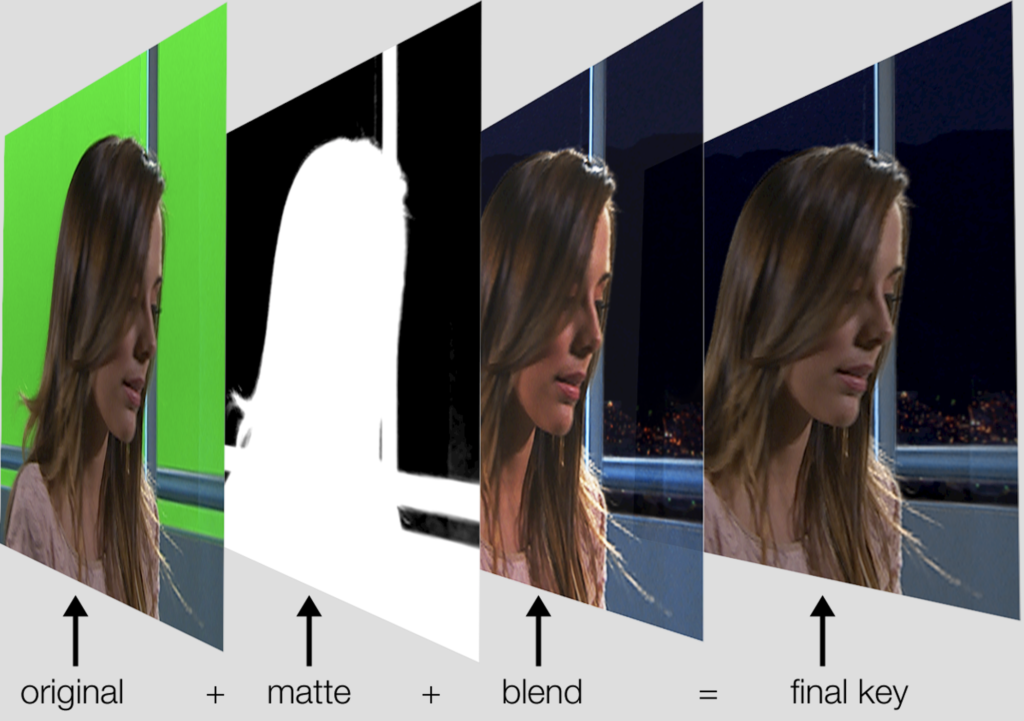

L’incrustation permet d’incruster un acteur filmé sur fond vert ou bleu dans un décor (souvent créé grâce à la technique du matte painting). À l’aide d’un logiciel, l’incrustation permet d’intégrer sur une même image des objets, des acteurs et des décors filmés séparément, ainsi que des objets 3D créés numériquement.

Pourquoi du vert, pourquoi du bleu ? Ces deux couleurs sont les plus éloignées des tons de la peau humaine ce qui permet de créer une découpe nette. En vidéo, et plus particulièrement au cinéma, les réalisateurs ont tendance à utiliser du vert. En effet, les capteurs des caméras vidéos sont plus sensibles au vert, la découpe en est donc d’autant plus précise. Le bleu, quant à lui, est plus difficile à utiliser puisqu’il nécessite plus de lumière. Le choix du fond dépend donc de ces différents facteurs, ainsi que des couleurs présentes sur le plateau. Par exemple, si l’acteur filmé sur fond bleu porte un pantalon bleu, celui-ci risque de devenir invisible !

Et plus concrètement ? Toutes les parties vertes ou bleues de l’image permettent de créer un signal de découpe (ce qui est vert ou bleu prend la valeur 1, le reste la valeur 0). Cela produit une image en noir (les éléments filmés) et blanc (les éléments verts ou bleus). Cette nouvelle image permet d’intégrer de nouveaux éléments sur les formes restées blanches.

C’est ainsi que des images de synthèse peuvent remplacer certains sujets utilisés lors du tournage. Prenons l’exemple de Game of Thrones. Lorsque Daenerys interagit avec son dragon, un objet vert représente la créature sur le plateau de tournage. C’est seulement lors de la période de post-production que le dragon prend vie. Néanmoins, le fait d’avoir un objet, et parfois même un acteur de référence (qu’on remplacera en post-production), aide l’acteur à mettre en place son jeu et le réalisateur à effectuer les bons mouvements de caméra.

La doublure numérique : recréer un acteur

La doublure numérique est un effet visuel qui permet de recréer le physique, les mouvements et les expressions d’un acteur. Cela permet ainsi d’obtenir une scène qu’un acteur ne veut ou ne peut pas faire (une cascade dangereuse par exemple).

Plusieurs étapes sont nécessaires à la création d’une doublure numérique. D’abord, il s’agit de capter les expressions du visage de l’acteur grâce à la technique de la performance capture. Cette technique est sensiblement la même que celle de la motion capture (décrite plus haut), mais dans la mesure où elle est restreinte au visage, les mouvements capturés sont plus précis. Ensuite, la motion capture permet de capturer les attitudes corporelles de l’acteur. Puis, l’acteur passe dans une sphère formée de milliers de LED afin de capter avec précision son physique et de pouvoir le reproduire numériquement à l’identique. Une fois ces étapes passées, les textes du comédien sont enregistrés. L’assemblage de ces différentes étapes permet d’animer le comédien numériquement.

Cette technique permet également de ressusciter des acteurs. Elle a notamment été utilisée pour finaliser le tournage de Fast and Furious 7 suite à la mort de Paul Walker. À partir d’images tirées des films précédant, le studio de post-production Weta Digital a créé sa doublure numérique. Les deux frères de l’acteur ont servi de doublures lors du tournage. Ayant la même carrure, ils ont joué avec des capteurs sur le visage, ce qui a permis de transposer le visage numérique de Paul sur les leurs.

Cette vidéo vous explique comment le studio Weta Digital a créé la doublure numérique de Paul Walker.

Donc, avec un ordinateur tout le monde peut créer un effet visuel ? Point sur le travail de l’infographiste.

Évidemment, les effets spéciaux ne tombent pas du ciel. Ils n’apparaissent pas non plus directement dans l’objectif du cadreur au moment du tournage. Quand sont-ils créés et ajoutés au film ? Et surtout, par qui ?

La phase de post-production

Un film se réalise en 3 phases : la pré-production, le tournage et la post-production. La phase de pré-production aide à identifier les effets spéciaux nécessaires au film et à les concevoir selon les directives du réalisateur. Néanmoins, c’est seulement en post-production (après le montage) qu’on les incorpore au film. C’est là tout le travail de l’infographiste.

Une fois le film monté, l’infographiste se charge donc d’y ajouter les effets spéciaux. Il incorpore les matte painting aux scènes, ajoute les doublures numériques et autres personnages virtuels, amplifie les effets spéciaux mécaniques (les explosions par exemple), etc… Tout ce travail d’assemblage relève d’une technique appelée le compositing. Il s’agit de superposer tous les effets spéciaux du film pour en faire un plan unique. Une fois ce plan unique obtenu, l’infographiste utilise la technique du nettoyage. Il s’agit d’effacer les incohérences présentes dans la scène (par exemple, le reflet de la caméra dans un miroir). La touche finale du film est ensuite l’étalonnage, c’est-à-dire le traitement de l’image en termes de couleurs et de luminosité. Cela permet aux différents effets de se mélanger dans un même plan de façon cohérente et qui semble la plus réelle possible.

La question demeure : tout le monde peut-il créer ses propres effets spéciaux ? La réponse est « oui, mais »…

Les studios d’effets visuels s’appuient sur différents logiciels pour créer leurs effets spéciaux. Les plus connus (et utilisés) sont Nuke, After Effects, Photoshop et Fusion de BlackMagic. Ces logiciels sont propres à certains types d’effets spéciaux, par exemple Photoshop est surtout utilisé pour la création des matte painting, quand Nuke sert davantage pour le compositing. Ainsi, toute personne possédant l’un de ces logiciels peut s’aventurer dans le domaine des effets spéciaux.

En revanche, ne nous leurrons pas. Les effets visuels d’un film amateur n’auront rien d’aussi impressionnant que ceux des grandes productions. Logique, me direz-vous. Au sein d’un studio, chaque infographiste possède une spécialité. Ainsi, celui qui crée un matte painting ne gérera pas le compositing, etc. La création de gros effets spéciaux nécessite donc une formation et une véritable expertise.

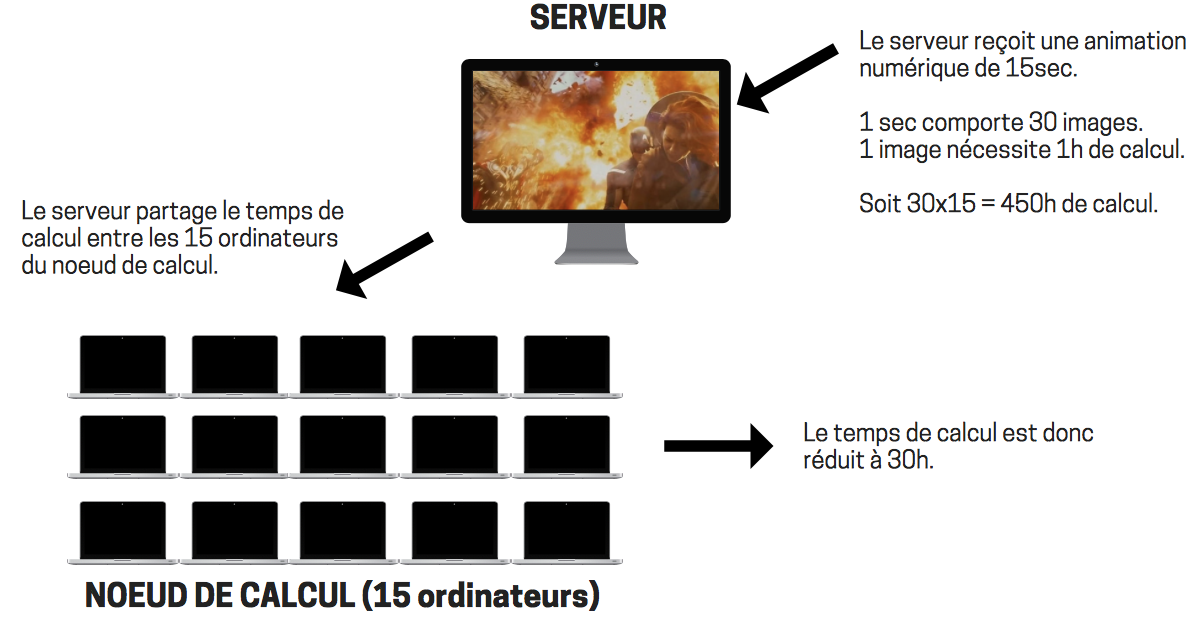

De plus, pour optimiser leurs réalisations, les studios d’effets visuels s’appuient sur ce qu’on appelle des render farms (ou fermes de rendu). Ce sont des grappes d’ordinateurs, dont l’ordinateur principal (le « serveur ») supervise la distribution des tâches aux autres ordinateurs (les « noeuds de calcul »). Celles-ci permettent de calculer le rendu des images de synthèse. Plus le temps de calcul est long, plus le rendu final de la scène est précis. Là-encore, tout le monde peut se procurer une render farm, voire s’en fabriquer une. En revanche, les plus performantes (celles utilisées par les studios professionnels) coûtent extrêmement cher, d’où un rendu final meilleur.

Conclusion

Tous ces exemples montrent que le numérique a fortement bouleversé le monde du cinéma. Néanmoins, les effets spéciaux mécaniques sont encore bel et bien présents. Le maquillage et les maquettes restent indispensables. Certains acteurs tels que Tom Cruise refusent d’avoir recours à une doublure numérique et continuent d’effectuer leurs cascades seuls. Le « tout numérique » possède donc encore des limites. Les films y ayant recours aujourd’hui sont uniquement des films d’animation. Malgré cela, les effets numériques continuent de se perfectionner. Les réalisateurs peuvent désormais donner vie à leurs rêves les plus fous, de Spielberg aux réalisateurs de court-métrages amateurs. En effet, le recours croissant à la technologie numérique permet un accès simplifié aux logiciels de retouches, aux applications de traitement de vidéos, aux tutoriels. Ainsi, tout le monde peut aujourd’hui s’aventurer dans le milieu des effets spéciaux.

Merci à Rémy Hérault (Hotsoft) pour la photo de couverture.

Gates

15 mars 2019 at 9 h 30 min

c tro coul

Retrolien : Les tendances du marché du jeu vidéo en 2018 – Victor Droin Blog Personnel